Decision tree atau pohon keputusan adalah salah satu konsep penting dalam data science dan machine learning. Meskipun terdengar kompleks, decision tree adalah alat yang sangat efektif untuk mengambil keputusan berdasarkan data.

Key Takeaways

- Decision tree adalah model data yang menggambarkan serangkaian keputusan dan konsekuensi yang mungkin terjadi berdasarkan aturan pemisahan atribut.

- Proses kerja decision tree memiliki beberapa tahapan, dimulai dari pemilihan atribut terbaik hingga hasil akhirnya adalah pohon keputusan yang dapat digunakan untuk klasifikasi data baru dengan mengikuti cabang-cabang yang sesuai.

- Terdapat beberapa jenis decision tree, seperti ID3, C4.5, CART, random forest, gradient boosting trees, dan CHAID.

Dalam artikel ini, kita akan menjelajahi apa itu decision tree, cara kerja, dan manfaatnya dalam berbagai bidang. Mari kita memahami dasar-dasar konsep ini dan bagaimana kita dapat memanfaatkannya untuk pengambilan keputusan yang lebih baik dan cerdas.

Apa itu Decision Tree?

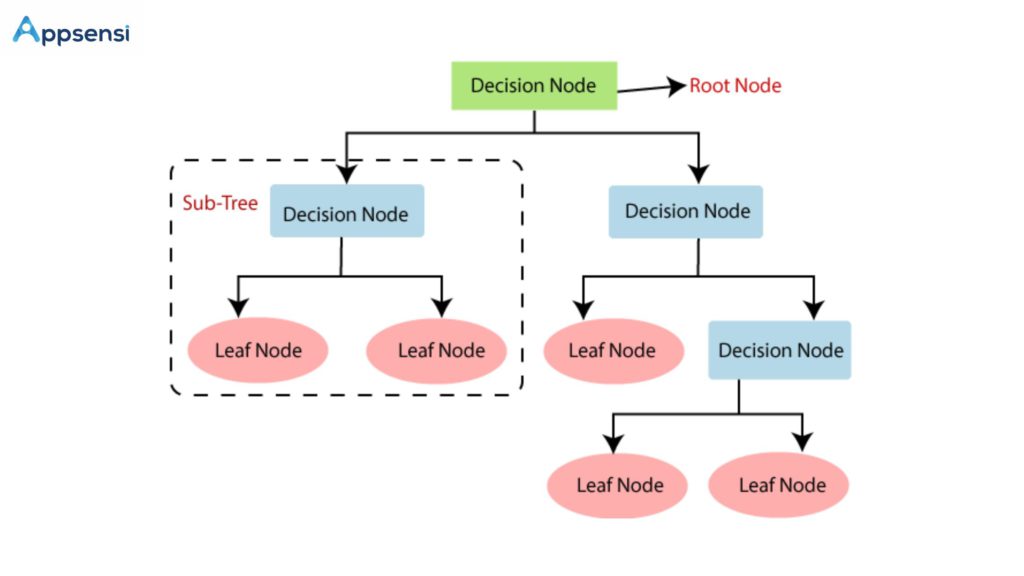

Decision tree atau pohon keputusan adalah model data yang menggambarkan serangkaian keputusan dan konsekuensi yang mungkin terjadi berdasarkan aturan pemisahan atribut. Model ini digunakan untuk pengambilan keputusan dan klasifikasi berdasarkan data input dengan membagi data ke dalam cabang-cabang pilihan yang akhirnya mengarah ke hasil akhir.

Decision tree sangat berguna dalam analisis data, machine learning, dan pengambilan keputusan. Hal ini karena dapat membantu dalam memahami hubungan antara berbagai atribut dan mengidentifikasi solusi yang optimal dalam suatu konteks.

Proses Kerja Decision Tree

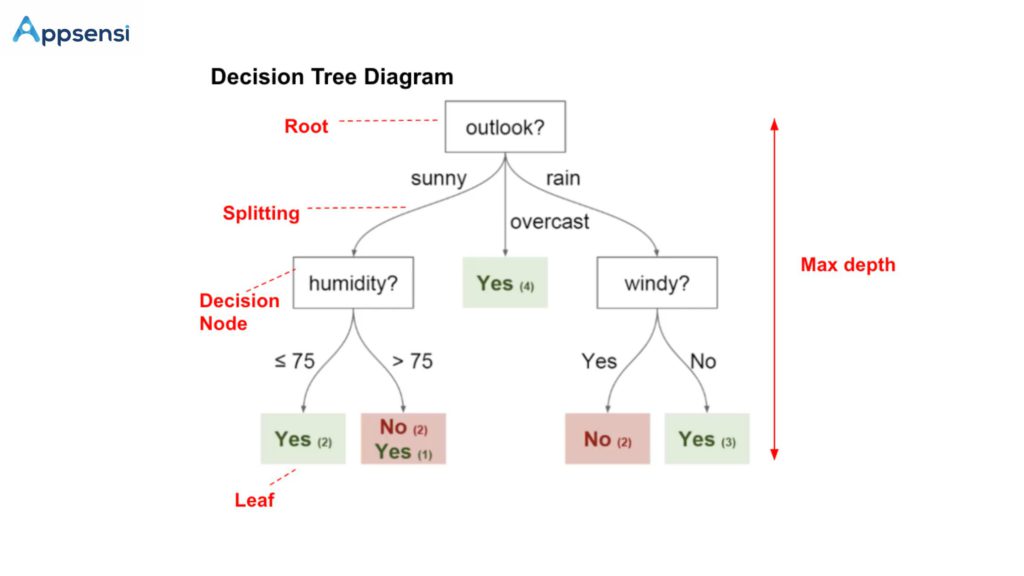

Proses kerja decision tree dimulai dengan pemilihan atribut terbaik untuk memisahkan data input menjadi subset yang lebih kecil dan lebih homogen. Pemilihan atribut ini didasarkan pada kriteria seperti Information Gain atau Gini Impurity yang bertujuan untuk mengurangi ketidakpastian atau impurity dalam setiap subset.

Setiap atribut diuji untuk melihat mana yang memberikan pemisahan terbaik. Setelah atribut terbaik dipilih, decision tree bercabang, dengan setiap cabang mewakili nilai atau kategori yang berbeda dari atribut tersebut.

Proses ini terus berlanjut secara rekursif untuk setiap cabang hingga mencapai daun (leaf node) yang mewakili hasil atau label klasifikasi akhir. Hasilnya adalah pohon keputusan yang dapat digunakan untuk mengambil langkah keputusan berdasarkan input dengan mengikuti cabang-cabang yang sesuai.

Selama proses ini, decision tree juga dapat mengalami pemangkasan (pruning) untuk menghindari overfitting, yaitu cabang-cabang yang tidak memberikan manfaat signifikan dihapus untuk memperbaiki generalisasi model.

Hasil akhir adalah pohon keputusan yang dapat digunakan untuk klasifikasi data baru dengan mengikuti cabang-cabang yang sesuai, sehingga memungkinkan pengambilan keputusan yang lebih baik dan mudah dipahami berdasarkan aturan-aturan yang terwakili dalam struktur pohon tersebut.

Baca juga: Business Analyst adalah: Tugas dan Skill yang Harus Dimiliki

Jenis-jenis Decision Tree

1. Iterative Dichotomiser 3 (ID3)

ID3 adalah salah satu algoritma decision tree pertama yang dikembangkan. Ini menggunakan information gain sebagai metrik pemilihan atribut. ID3 lebih cocok untuk data yang memiliki atribut kategorikal.

2. C4.5

C4.5 adalah pengembangan dari ID3 yang memungkinkan penggunaan atribut numerik. Algoritma ini menggunakan gain ratio untuk pemilihan atribut yang mengatasi kelemahan information gain dalam mengatasi atribut dengan banyak nilai.

3. Classification and Regression Trees (CART)

Algoritma CART dapat digunakan untuk klasifikasi (menghasilkan pohon keputusan untuk klasifikasi) dan regresi (menghasilkan pohon keputusan untuk prediksi numerik). Ini menggunakan gini impurity sebagai metrik pemilihan atribut.

4. Random Forest

Random forest adalah teknik ensemble yang menggunakan banyak decision trees untuk meningkatkan akurasi prediksi. Setiap decision tree dalam random forest dikonstruksi secara acak dan hasil prediksi diambil melalui voting atau rata-rata dari semua pohon.

5. Gradient Boosting Trees

Gradient boosting adalah teknik ensemble yang menggabungkan serangkaian decision trees, dimana setiap pohon memperbaiki kesalahan yang dibuat oleh pohon sebelumnya. Ini memungkinkan pembuatan model yang sangat kuat.

6. Chi-squared Automatic Interaction Detector (CHAID)

CHAID adalah algoritma yang cocok untuk kategorikal dan menggabungkan teknik analisis statistik dengan pembuatan pohon keputusan.

Setiap jenis decision tree memiliki karakteristik unik dan mungkin lebih cocok untuk jenis data atau masalah tertentu. Pemilihan jenis decision tree tergantung pada kebutuhan dan sifat data yang Anda hadapi.

Kelebihan Decision Tree

1. Kemudahan Pemahaman

Decision tree adalah model yang mudah dipahami dan diinterpretasi oleh manusia. Pohon keputusan menggambarkan proses pengambilan keputusan dalam cara visual yang mudah diikuti.

2. Kemampuan dalam Mengatasi Data yang Campuran

Decision tree dapat mengatasi baik atribut kategorikal maupun numerik, serta campuran keduanya. Ini membuatnya sangat serbaguna untuk berbagai jenis informasi.

3. Pemilihan Atribut Otomatis

Decision tree secara otomatis memilih atribut terbaik untuk pemisahan data, menghilangkan kebutuhan untuk pemilihan atribut manual.

4. Dukungan untuk Klasifikasi dan Regresi

Decision tree dapat digunakan baik untuk mengategorikan data ke dalam kelas maupun regresi (memprediksi nilai numerik), menjadikannya alat yang fleksibel dalam machine learning.

5. Interpretabilitas Model

Model decision tree dapat membantu mengidentifikasi atribut yang paling berpengaruh dalam pengambilan keputusan, yang dapat berguna dalam analisis dan pengambilan keputusan bisnis.

6. Pengambilan Keputusan dengan Berbagai Kriteria

Anda dapat mengubah kriteria pemilihan atribut sesuai dengan masalah yang dihadapi, seperti menggunakan information gain, gain ratio, atau gini impurity, sehingga meningkatkan kontrol atas model.

7. Pemangkasan (Pruning) Model

Pohon keputusan dapat dipangkas untuk menghindari overfitting yang memungkinkan pembentukan model yang lebih umum dan tidak terlalu spesifik terhadap data pelatihan.

8. Efisiensi dalam Komputasi

Decision tree memiliki waktu komputasi yang relatif singkat untuk pembuatan model dan prediksi, sehingga cocok untuk dataset besar.

9. Dukungan untuk Kombinasi dengan Teknik Ensemble

Decision tree dapat diintegrasikan dalam teknik ensemble, seperti random forest dan gradient boosting untuk meningkatkan akurasi prediksi.

Baca juga: Digital Savvy adalah: Berikut Pengertian dan Penjelasannya

Kekurangan Decision Tree

1. Kemungkinan Overfitting

Decision tree cenderung memahami detail yang sangat kecil dari data pelatihan dan dapat menjadi terlalu kompleks. Ini mengakibatkan overfitting, dimana model bekerja sangat baik pada data pelatihan tetapi buruk pada data uji atau data baru.

2. Kekurangan dalam Menangani Data yang Tidak Seimbang

Decision tree cenderung menghasilkan pohon yang bias terhadap kelas mayoritas dalam data yang tidak seimbang. Ini dapat menyebabkan klasifikasi yang buruk untuk kelas minoritas.

3. Ketidakstabilan terhadap Perubahan Data Kecil

Perubahan kecil dalam data pelatihan dapat menghasilkan pohon keputusan yang berbeda, sehingga model bisa tidak stabil.

4. Kurang Efisien dalam Mengatasi Data Numerik

Algoritma decision tree kurang efisien dalam mengatasi data numerik dibandingkan dengan data kategorikal. Untuk data numerik, pre-processing tambahan sering diperlukan.

5. Keterbatasan dalam Menangani Data yang Memiliki Hubungan Kuadrat (Nonlinear)

Decision tree cenderung memahami hubungan linear antara atribut, sehingga kurang efektif dalam menangani data yang memiliki hubungan nonlinear.

6. Kurangnya Kemampuan Menggabungkan Informasi

Decision tree tidak selalu mampu menggabungkan informasi dari beberapa atribut yang mungkin perlu digabungkan untuk membuat keputusan yang lebih baik.

7. Kurangnya Dukungan untuk Data yang Hilang

Decision tree tidak tahan terhadap data yang hilang atau missing data. Perlu dilakukan penanganan khusus untuk kasus ini.

Untuk decision tree dan pemanfaatannya dalam HR, tentu dibutuhkan data berupa absen yang valid, jam hadir dan pulang yang tepat, dan lainnya. Tak perlu repot, Anda dapat memanfaatkan aplikasi Appsensi untuk mempermudah proses pengumpulan data ini. Pelajari lebih lanjut untuk memulai efisiensi manajemen karyawan perusahaan Anda sekarang.

Tulis Komentar